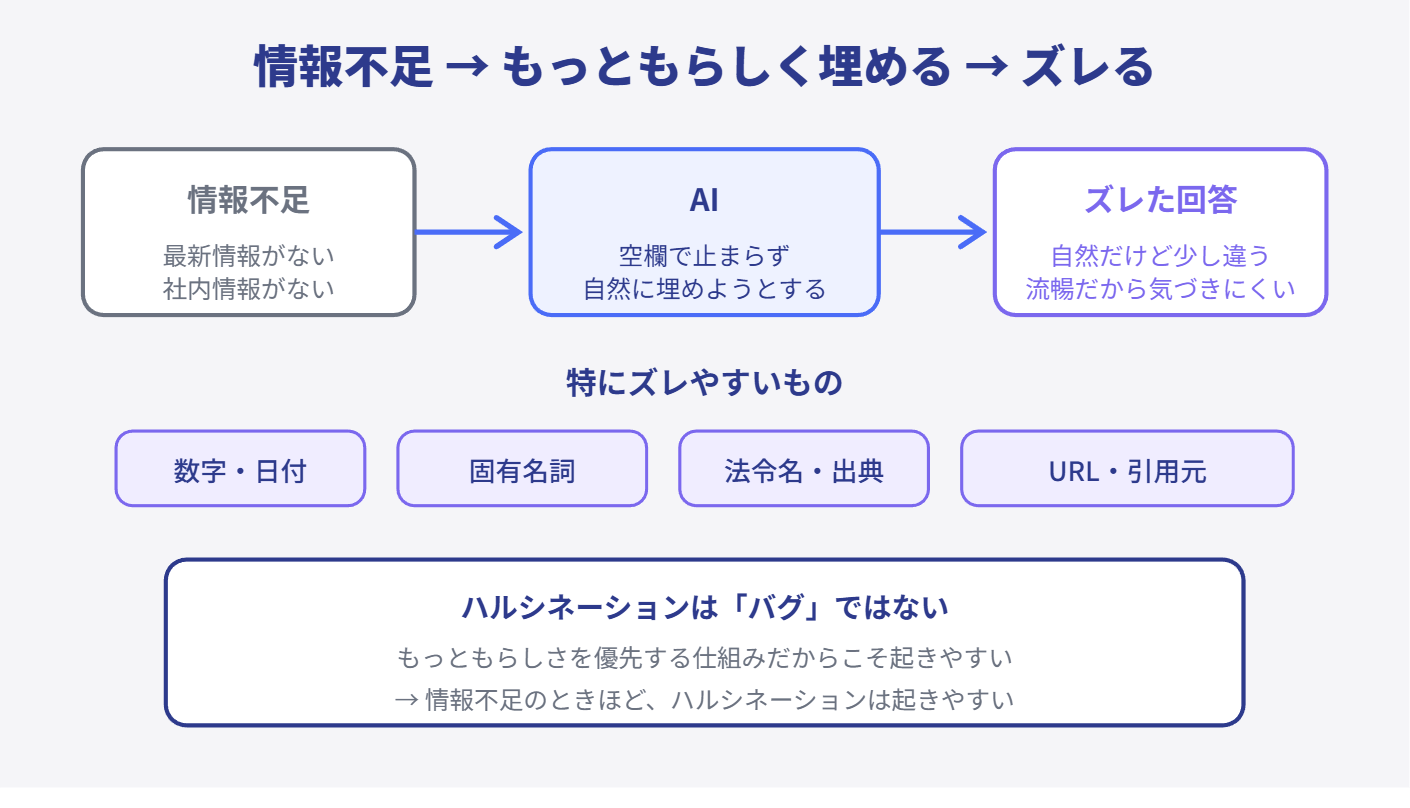

ハルシネーションとは、生成AIが「もっともらしさを優先して埋めにいくことで起きるズレ」です。

この記事でわかること

- ハルシネーションが「バグ」ではなく「仕組み上自然なこと」である理由

- 「自然さ」と「正しさ」が別物であることの重要性

- 情報不足のときほどズレやすい理由と、実務での向き合い方

生成AIを使っていて、いちばん不思議なのはここかもしれません。

自然な文章を返してくる。前後の流れも読めているように見える。言い回しも滑らか。それなのに、ときどき内容がズレる。

しかも、そのズレ方がやっかいです。明らかに変なら、まだ気づきやすい。でも実際によくあるのは、「すごく自然だけど、少し違う」です。

存在しない資料名をそれっぽく言う。確認していない数字を自然に置く。制度やルールをもっともらしく説明する。引用元があるように見えて、実は正確ではない。

こういう現象が、よくハルシネーションと呼ばれます。

最初にひとことで言うと、ハルシネーションは生成AIが「もっともらしさを優先して埋めにいくことで起きるズレ」です。

ここをちゃんと理解しておくと、生成AIを怖がりすぎず、でも過信しすぎずに使いやすくなります。

ハルシネーションは「壊れた挙動」ではない

まず大事なのはここです。

ハルシネーションという言葉を聞くと、何か異常なことが起きているように感じるかもしれません。でも実際には少し違います。

生成AIにとって、自然な文章を続けようとするのは基本動作です。第1回でも見たように、生成AIは「次にもっともらしいものを出していく仕組み」でした。

つまり、分からないところに出会ったときでも、そこで急に黙るのではなく、それまでの流れから自然そうなものを出そうとします。

人間なら、「そこは分かりません」「情報が足りません」と止まることができます。でも生成AIは初期設定のままだと、そこでも続けようとする。

だからハルシネーションは「バグ」というより、生成AIの基本動作をそのまま進めた結果として起きやすいものです。

会社名のあとに部署名が続きそうなら、それっぽい部署名を置く。書籍名が必要そうなら、それっぽいタイトルを作る。典型的な説明が求められていそうなら、一般的にありそうな説明を返す。これは「嘘をつこう」としているわけではありません。文脈に対して自然な答えを返そうとしすぎた結果です。

「自然さ」と「正しさ」は別物

ここが、生成AIを使ううえで最も大事な感覚のひとつです。

生成AIは、自然な文章を作れます。でも、自然であることと正しいことは違います。

文章の流れは自然、口調も適切、形式もきれい。でも中身の一部が事実と違う。これが普通に起きます。

生成AIが強いのは「自然に見える形に整えること」です。一方で「現実世界の事実を保証すること」は別の話です。ここを同じだと思ってしまうと、危ない。生成AIをうまく使う人ほど、この2つを分けて見ています。

さらに言えば、流暢に答えられることと、正確に知っていることも別です。生成AIは文脈に合わせて自然に答える力がとても強い。だから、分からないことでも流暢に返せてしまう。人間は分からないことを話すとき、どこかで言いよどみます。でも生成AIは文体が崩れにくい。だからなおさら「分かっていそう」に見える。

つまりハルシネーションの怖さは、内容が間違うことそのものだけではありません。間違っていても、見た目が整いすぎていること。ここにもあります。

情報が足りないときほど、ズレは起きやすい

ここは実務的に大事です。

生成AIがズレやすい場面には、ある程度共通点があります。それは、必要な情報が足りないときです。

- 最新情報が必要なのに与えられていない

- 社内ルールや社内文脈が必要なのに持っていない

- 固有名詞や数字の正確性が必要なのに確認材料がない

- 条件が曖昧なまま答えを出そうとしている

こういうとき、生成AIは「情報が足りないので止まります」ではなく「文脈から自然そうなものを作ります」に寄りやすい。

だから情報不足のときほどハルシネーションは起きやすいです。特に数字、日付、固有名詞、法令名、出典、URLは「自然にそれっぽいものを置く」ことが特に危険な領域です。文章全体の流れとしては自然。でも数字が1つ違うだけで意味が変わります。

また、問いそのものが広すぎたり曖昧だったりしても同じです。「どうすれば売上が上がりますか」のような条件が少なすぎる依頼では、「ありそうな一般論」が返ってきやすい。これも広い意味ではハルシネーションに近いズレです。

ハルシネーションは「前提にして使う」

ここは重要です。

「ハルシネーションがあるなら危なくて使えないのでは」と思うこともあるかもしれません。でも、実務ではそこまで極端に考えなくていいです。

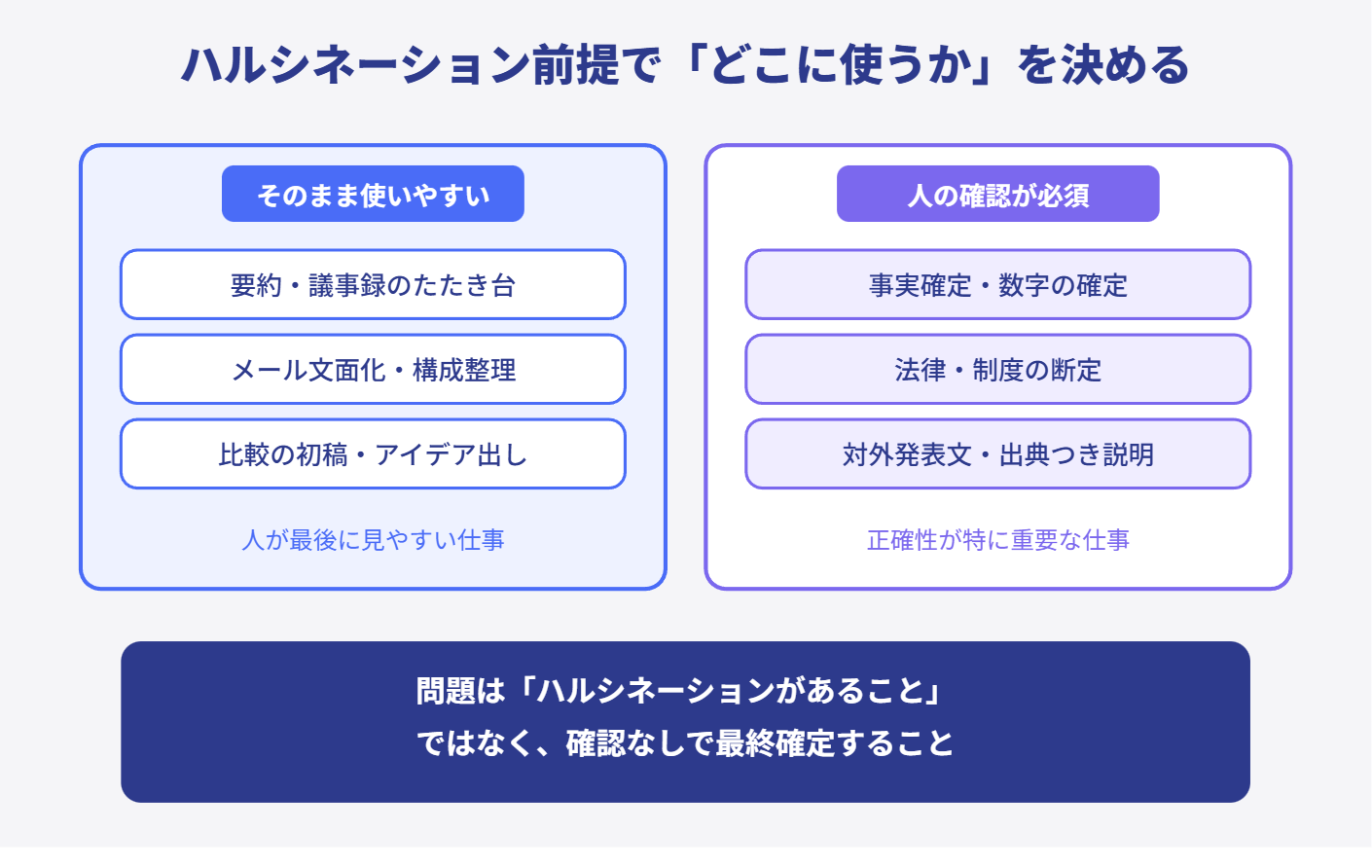

大事なのは、ハルシネーションをゼロにすることより、起きうる前提でどこに使うかを決めることです。

要約、議事録のたたき台、メール文面化、比較の初稿、構成整理、アイデアの幅出し。こういうものは使いやすい。人が最後に見やすいからです。

一方で、最終的な事実確定、数字の確定、法律や制度の断定、対外発表の確定文、出典つきの説明。こういうものは、人が確認前提で扱う。

つまり問題は「ハルシネーションがあること」そのものではなく、ハルシネーションがありうるのに最終確定までAIに任せてしまうことです。

ここまで来ると、次の仕組みの話ともつながります。生成AIがズレる大きな理由のひとつは、持っていない情報を自然さで埋めようとすることでした。なら、必要な情報をちゃんと渡す。もしくは、必要な情報を取りに行けるようにする。ここで出てくるのが、検索、RAG、外部参照、メモリ、ツール連携のような話です。

ハルシネーションと「単なる間違い」は何が違うのか

| ハルシネーション | 単なる事実誤認 | 情報不足による一般論 | |

|---|---|---|---|

| 原因 | もっともらしさで埋めにいく | 学習データ内の誤った情報 | 固有情報がないため一般的な回答に寄る |

| 見た目 | 自然で流暢。気づきにくい | 自然だが確認すれば分かる | 「それっぽいが当社の事情と違う」 |

| 危険度 | 高い(存在しない資料名等を作る) | 中程度 | 低め(だがそのまま使うとずれる) |

| 対策 | 人による確認+RAGで情報を渡す | 出典確認 | 社内情報をRAG等で渡す |

よくある疑問

ハルシネーションはゼロにできますか?

完全にゼロにはできません。仕組み上、もっともらしさで埋める動きは基本動作の一部です。大事なのはゼロを目指すことより、起きる前提でどこに使うかを決めることです。

どんなときに特に起きやすいですか?

数字・日付・固有名詞・法令名・URLなど、正確性が求められる領域が特に危険です。また、問いが広すぎる・曖昧なときも「ありそうな一般論」に寄りやすくなります。

RAGを入れればハルシネーションはなくなりますか?

RAGは情報不足を減らす仕組みであり、ハルシネーションのリスクを下げます。ただしゼロにはなりません。検索のズレや古い資料の参照など、別の原因でズレることもあります。

まとめ

この記事のポイントを3つにまとめます。

- ハルシネーションはバグではなく、「もっともらしさで埋めにいく」という基本動作の延長で起きる

- 「自然さ」と「正しさ」は別物。流暢な出力でも事実確認は必要

- 情報不足のときほどズレやすいので、RAGや検索で情報を渡すか、「最後は人が確認する」場所を決める

次回は「プロンプトで何が変わるのか」をやります。

ここまでで、生成AIは続きを予測していること、トークン単位で文脈を見ていること、トランスフォーマーで重要な場所を拾っていること、それでも自然さを優先するからズレることがある。ここまで見えてきました。では次に気になるのが、「じゃあ、こちらの指示でどこまで変えられるの?」という話です。次はそこをやります。