トランスフォーマーとは、AIが文章全体を見渡しながら「どこを重く見るか」を決めて処理する仕組みです。

この記事でわかること

- Attention(注意機構)が何をしているか

- トランスフォーマーが生成AIの「読む力」を押し上げた理由

- 「見ている」ことと「理解している」ことの違い

生成AIの仕組みを少し調べると、早い段階で出てくる言葉があります。トランスフォーマーです。

なんとなく重要そう。生成AIの中核らしい。でも、ここで一気に難しく感じる人も多いと思います。技術記事では急にAttention、Self-Attention、Encoder、Decoderといった言葉が並び始める。すると、そこで読むのをやめたくなる。

でも、最初に必要なのはそこまでの厳密さではありません。

仕事で生成AIを使う人にとって大事なのは、トランスフォーマーとは、AIが「どこを見ながら次を決めるか」をうまく扱える仕組みなんだとつかむことです。

この感覚があると、その先の疑問が理解しやすくなります。なぜ長い文脈を踏まえた返答ができるのか、なぜ直前の単語だけでなく前の文章全体の流れを見られるのか、なぜ指示や条件を入れると出力が変わるのか。

生成AIは、前の1語だけ見ているわけではない

第1回では、生成AIは「次にもっともらしい続きを出している」と書きました。

ここで誤解しやすいのが、「じゃあ直前の単語だけ見て、続きっぽいものを出しているの?」というイメージです。もしそうだとすると、生成AIの文章はもっと不自然になります。

たとえば人間でも、文章の続きを考えるとき、直前の1語だけを見るわけではありません。「このメールは丁寧に返したい」「さっき断りの文脈があった」「相手は社外の人だ」といった前後の流れを広く見ています。

生成AIも同じで、少なくとも今の生成AIは直前だけを見ているわけではありません。前に出てきたトークン全体の関係を見ながら、次を決めています。

ここで中心になる考え方が、よく言われるAttentionです。

Attentionは「どこを重く見るか」を決める仕組み

Attentionという言葉は、日本語にすると「注意」とか「注目」に近いです。でも、最初はもっと雑に考えて大丈夫です。

生成AIの文脈では、Attentionはいま次を出すために、前のどこをどれくらい重く見るかを決める仕組みだと思ってください。

たとえば、こういう短い文があるとします。

「木曜日の会議は延期になりました。新しい日程は来週月曜です。」

このあとに「会議は___」という続きが来たら、AIは直前の「は」や「です」だけを見ても意味がありません。大事なのは、「会議」「延期」「新しい日程」「来週月曜」のように、前に出てきた重要な部分です。

つまり、次を決めるときには前の全部を同じ重さで見るのではなく、関係が強そうなところをより強く見る必要がある。そのための仕組みがAttentionです。

Attentionをもっと直感的に言うと、人間が文章を読むときに自然と目が止まる場所に少し近いです。人も文章を読むとき、すべての語を同じ重さで処理していません。重要な単語、主語、結論、さっき出てきた条件。そういうところに自然と注意が向きます。

生成AIも、次のトークンを出すときに「前のどこが今の予測に関係ありそうか」を計算しながら見ています。もちろん人間の注意と同じではありません。でも構造としては、全体を見ながら必要そうな場所を強く参照するという点で似ています。

トランスフォーマーは、文章全体を見渡しながら処理できる仕組み

ここで改めて、トランスフォーマーをひとことで言うとこうなります。

文章全体の中で、どの部分がどこと関係しているかを見ながら処理できる仕組み。

これが、生成AIの「読む力」を押し上げました。

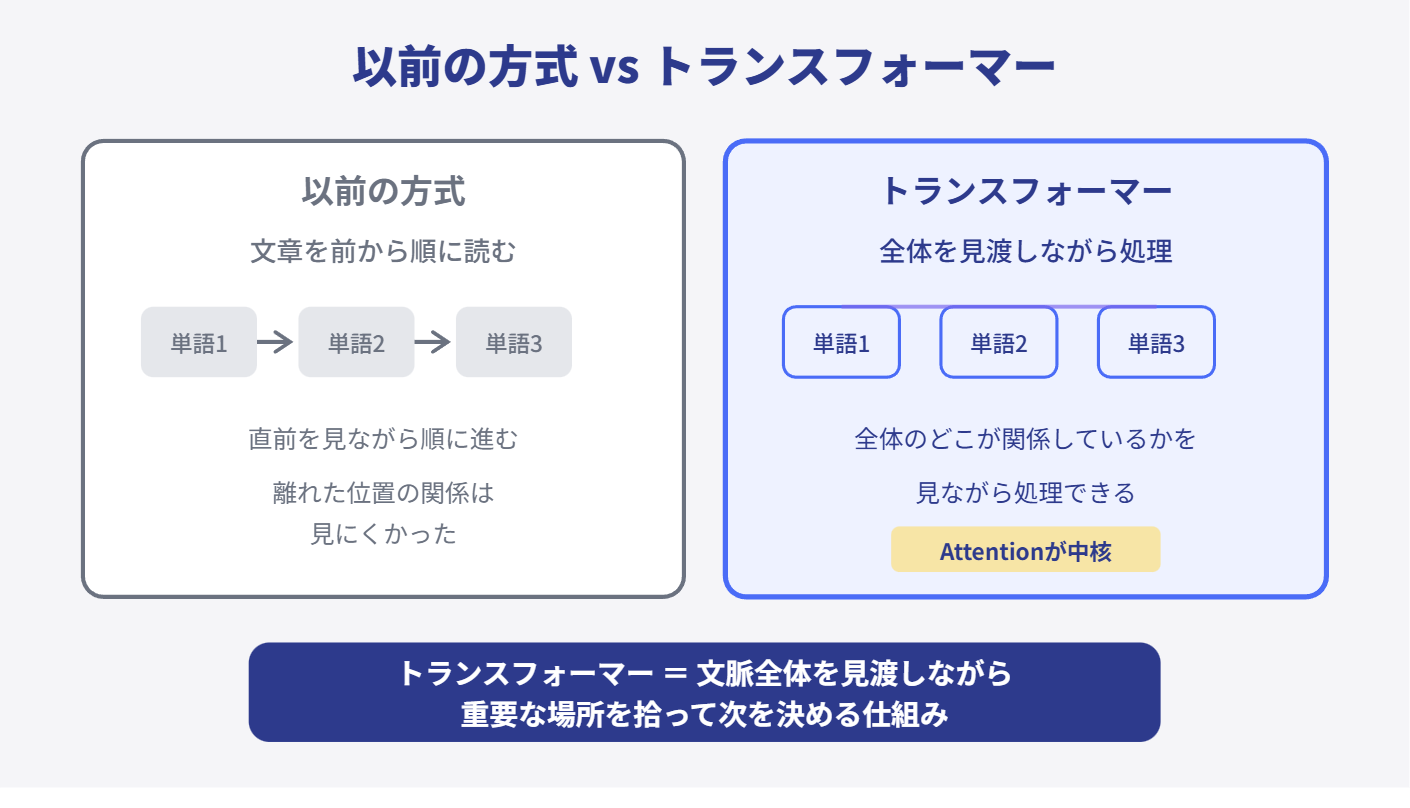

昔の仕組みがまったく文脈を見られなかったわけではありません。でも、長い文章や離れた位置にある言葉同士の関係を見るのは、今より苦手でした。

トランスフォーマーが強かったのは、文章を最初から最後まで流し読みするだけではなく、全体を見渡しながら関係を取れるところです。たとえば、最初に出てきた条件、中盤で出てきた例外、最後に求められている出力形式。こういうものを、前後の距離があっても見やすい。

だから長い指示にもある程度対応できるし、複雑な文章でもそれっぽく流れを保てます。

ただし「見ている」ことと「理解している」ことは違う

トランスフォーマーの話をすると、「じゃあやっぱり理解しているんだね」と思いやすい。でも、ここは少し慎重に見た方がいいです。

生成AIは、前後関係やトークン同士のつながりをうまく扱えます。でも、それは必ずしも人間のように意味を理解しているということではありません。前のどこを見るべきかをうまく計算している。関係が強そうなところを重く見ている。その結果、非常に自然な出力が出る。

でもそれをそのまま「人間のように読んで理解している」と重ねると、少しズレる。このズレがあるからこそ、流暢なのに事実が違う、条件は拾っているのに結論が変、ということが起きます。

プロンプトでも「重要な情報をどこに置くか」が効いてくる

ここまで分かると、実務にも少し戻ってこられます。

何をしてほしいか、何が条件か、何を優先してほしいか、どんな形式で返してほしいか。こういう重要な情報を分かりやすく置く方がAIは扱いやすい。

もちろんモデル側が賢く拾ってくれます。でも、ぐちゃぐちゃに長く書かれた指示より、整理された指示の方が出力が安定しやすいのは、こういう仕組みとも相性があります。

つまり、AIが文脈を「見ている」からこそ、こちらも文脈を整理して渡した方が効きやすい。ここは実務的なポイントです。

ここまでの話をシンプルにまとめます。

トランスフォーマーとは、文章全体の中でどの部分がどこと関係しているかを見ながら処理する仕組み。その中核にあるのがAttention。つまり、次を出すために前のどこをどれくらい重く見るかを決める考え方。

これによって生成AIは、長い文脈の流れを踏まえやすくなり、条件や形式を反映しやすくなり、自然な文章を作りやすくなりました。

トランスフォーマーと以前の仕組みは何が違うのか

| トランスフォーマー | 従来のモデル(RNN等) | |

|---|---|---|

| 文脈の見方 | 文章全体を並列に見渡す | 前から順に流し読みする |

| 長い文脈への強さ | 離れた位置の関係も拾いやすい | 距離が離れると影響が薄れやすい |

| 処理速度 | 並列処理が可能で高速 | 逐次処理のため低速 |

| 現在の主流か | はい(GPT・Claude・Gemini等の基盤) | ほぼ置き換えられた |

よくある疑問

Attentionとトランスフォーマーは別物ですか?

Attentionは「どこを重く見るかを決める考え方」で、トランスフォーマーはそのAttentionを中核に使った「モデルの設計」です。関係としては、Attentionがエンジン、トランスフォーマーが車全体に近いです。

「文章全体を見る」というのは、人間の読解と同じですか?

同じではありません。トランスフォーマーはトークン同士の関係の強さを計算しています。「見ている」が「意味を理解している」とは限らない点は重要です。

実務で意識すべきことはありますか?

AIが「どこを重く見るか」を決める仕組みである以上、指示や条件を分かりやすく整理して渡すことが、出力の安定につながります。

まとめ

この記事のポイントを3つにまとめます。

- トランスフォーマーは、文章全体を見渡しながら「どこを重く見るか」を決めて処理する仕組み

- その中核にAttentionがあり、長い文脈や離れた位置の関係も拾えるようになった

- ただし「見ている」ことと「理解している」ことは別であり、そのズレがハルシネーションにつながる

次回は「生成AIはなぜズレるのか」をやります。

ここまでで、生成AIはトークンを単位に出力していること、そのとき前の文脈全体を見ていること、特に重要そうな場所を重く見ながら次を決めていること。ここまで見えてきました。では次に出てくるのが自然な疑問です。「そこまで文脈を見ているなら、なんで間違うの?」次はそこをやります。